概要

OLLAMA_HOST環境変数とWindowsファイアウォールを設定して、同じネットワーク上の他のデバイスからローカルLLMにアクセスする方法をまとめる。

手順

1. 背景

GPUを搭載したWindows PCにOllamaをインストールしてLLMモデルのホスティングとAPIエンドポイントの提供を担うサーバーとして活用する構成だ。実際の開発やスタディは慣れたmacOS環境で行い、LLMが必要な時だけWindowsのAPIを呼び出せばよいので、GPUリソースはWindowsが、開発環境はmacOSが担当する形で各デバイスの強みを活かせる。

ただし、Ollamaはデフォルトで127.0.0.1:11434でのみリクエストを受け付ける。同じPC上では問題ないが、MacからAPIを呼び出すには外部アクセスを許可する必要がある。

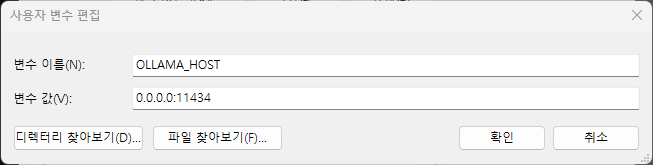

2. OLLAMA_HOST環境変数の設定

WindowsでOLLAMA_HOST環境変数を0.0.0.0:11434に設定すると、すべてのネットワークインターフェースからリクエストを受信するようになる。

Windows + S → 「環境変数」で検索 → システム環境変数の編集 → 環境変数ボタン → ユーザー変数で新規をクリックする。

- 変数名:

OLLAMA_HOST - 変数値:

0.0.0.0:11434

設定後、PCを再起動するかOllamaを再起動する必要がある。

2.1. 設定の確認

PowerShellでOllamaが正しいアドレスでリスニングしているか確認する。

netstat -an | findstr 11434

0.0.0.0:11434 LISTENINGと表示されれば正常だ。127.0.0.1:11434と表示される場合は再起動が必要だ。

3. Windowsファイアウォールの設定

環境変数を設定してもファイアウォールがポートをブロックすると外部からアクセスできない。管理者権限のPowerShellでファイアウォールルールを追加する。

New-NetFirewallRule -DisplayName "Ollama" -Direction Inbound -LocalPort 11434 -Protocol TCP -Action Allow

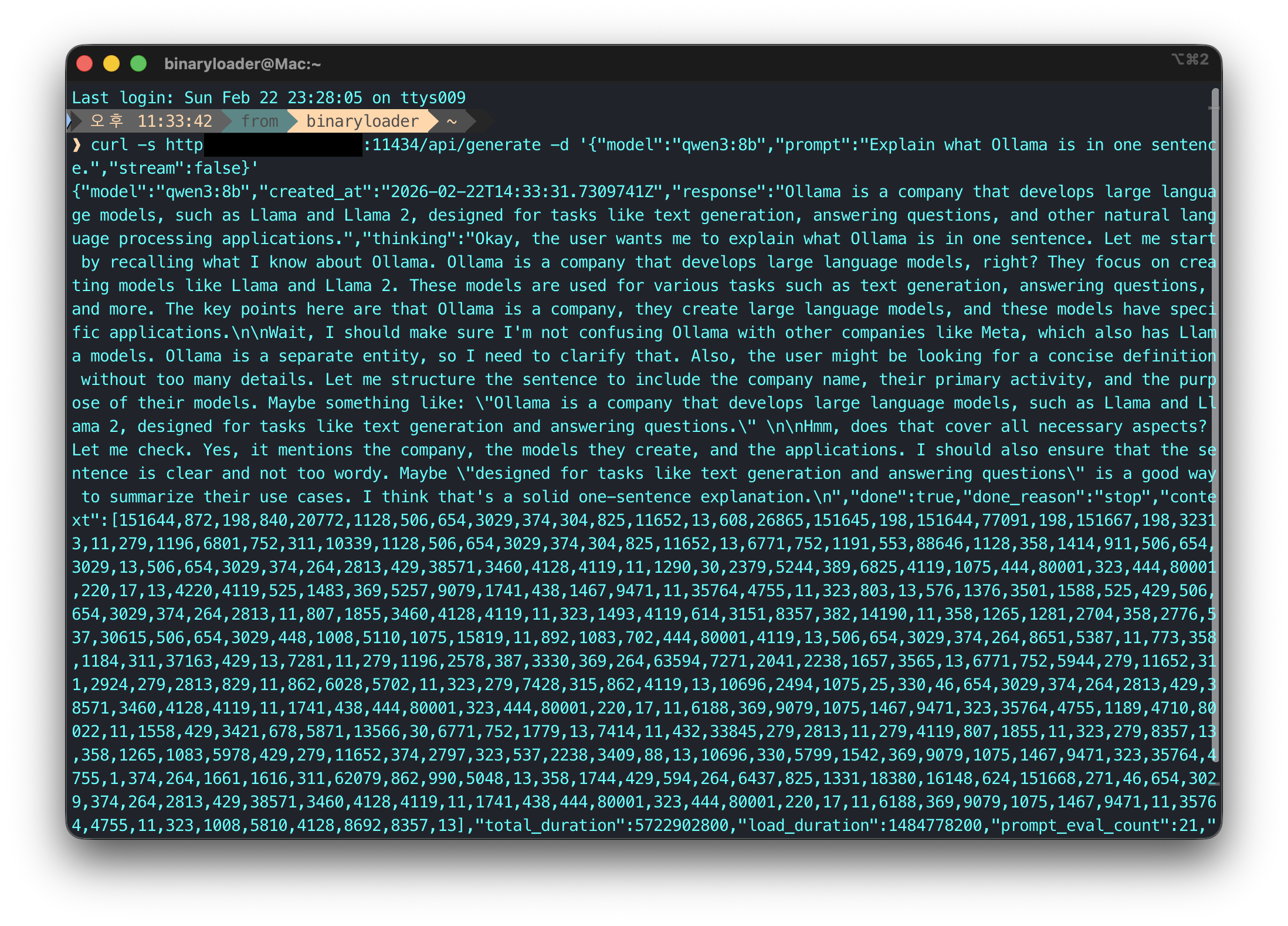

4. 他のデバイスからの接続テスト

同じネットワーク上のMacや他のデバイスからWindows PCのIPでAPIを呼び出す。Windows PCのIPはipconfigコマンドで確認できる。

curl -s http://<WindowsのIP>:11434/api/generate -d '{"model":"qwen3:8b","prompt":"Explain what Ollama is in one sentence.","stream":false}'

レスポンスが正常に返ってくれば設定完了だ。

コメントする